---

> [!NOTE] 目次

```table-of-contents

title:

minLevel: 0

maxLevel: 0

includeLinks: true

```

---

> [!NOTE] リスト掲載用文字列

- [【保存版】今やるべきAIリスク対策「8カ条」はこれ!失敗しない「超実践ステップ」](https://www.sbbit.jp/article/cont1/169975)【ビジネス+IT】(2025年08月18日)

---

> [!NOTE] この記事の要約(箇条書き)

- AIリスクは全企業にとって最重要課題であり、単なるガイドライン作成では不十分。

- 以下の8つの総合的な対策が必要とされる:

1. 現状調査(AI活用状況、リスク評価、ユースケース類型化)

2. AIドキュメント策定(ポリシー、ガイドライン)

3. AIガバナンス体制構築(所管部門、役割・責任、社外有識者の検討)

4. AI人材育成(教育コンテンツ、研修実施)

5. AIモニタリングプロセス整備(レビュープロセス、チェックシート)

6. AIモニタリングツール導入(PoC、導入、プロセス策定)

7. AIレッドチームによる診断(脆弱性評価、是正計画)

8. 継続的改善(対策の見直し、プロセス整備)

- 特に「現状調査」を怠るとガイドラインが形骸化するリスクがある。

- AIリスクは複数の専門性が重なり合うため、単一部門での対応は難しく、組織構造の変革と複数部門の連携が不可欠。

- 「AIリスクマネジメント部」の新設や、経済産業省が提唱する「アジャイル・ガバナンス」の採用が有効。

- アジャイル・ガバナンスは、AIリスクマネジメントを完璧に整えるのを待つのではなく、段階的に開始し、試行錯誤を通じて継続的に改善していく姿勢を推奨する。

> [!NOTE] 要約おわり

---

執筆:

AIリスクマネジメントの超実践ステップを解説

### 【保存版】AI時代、必ず実施すべき「AIリスク対策の8カ条」

生成AIの爆発的な普及により、AIは「誰でも自由に使える」時代に突入しました。しかしその裏側では、AIリスクもかつてないスピードで拡大しています。AIリスクに対応するために、生成AIの活用ルールをまとめた「生成AIガイドライン」を策定する動きが、民間企業だけでなく政府や自治体にも広がっています。

しかし、ガイドラインを作れば十分という考えは危険です。ガイドラインはあくまでルール(文章)であり、ルールを効果的・効率的に遵守(実行)していくためには、8つのステップを総合的に実施する必要があります(図表1)。

| No. | 種別 | AIリスク対策 | 実施内容 |

| --- | --- | --- | --- |

| 1 | \- | **現状調査** | - AI活用状況調査 - AIリスク観点とリスクレベル整理 - AIユースケースの類型化とリスク評価 |

| 2 | 人/組織 | **AIドキュメント策定** | - AIポリシー(社外)やAIガイドライン(社内ルール)策定 |

| 3 | 人/組織 | **AIガバナンス体制構築** | - AIリスク所管部門の整理 - 事業部門やコーポレート部門の役割と責任の整理 - 第三者委員会など、社外有識者を含めた体制検討 |

| 4 | 人/組織 | **AI人材育成** | - AIガバナンス教育コンテンツの策定 - 全社的な理解促進のための研修実施 |

| 5 | 人/組織 技術 | **AIモニタリングプロセス整備** | - AIサービスのレビュープロセス整備 - AIリスク観点に関する運用プロセスやチェックシートの策定 |

| 6 | 技術 | **AIモニタリングツール導入** | - AIモニタリングツール導入に向けたPoCの実施 - AIモニタリングツールの導入とモニタリングプロセスの策定 |

| 7 | 技術 | **AIレッドチームによる診断** | - 疑似攻撃によるAIサービス/モデルの脆弱性評価 - 評価結果に基づく是正計画の策定と実行 |

| 8 | \- | **継続的改善** | - AIリスク対策 No.1~7の定期的見直しと改善 - 継続的改善を実施するプロセス整備 |

【図表1】AIリスク対策の8カ条

(出典:PwCコンサルティング)

いずれの項目も重要ではありますが、特に、「1. 現状調査」をおろそかにしてしまうと、「法令/規制化や同業他社の動きに追随できなくなる」「自社内のAI利活用と不整合が生じてガイドラインが形骸化してしまう」といったことになりかねません。せっかく整備したAIリスクマネジメント態勢が、「絵にかいた餅」にならないように留意が必要です。

### 【図で全体像を把握】AIリスク対策の進め方

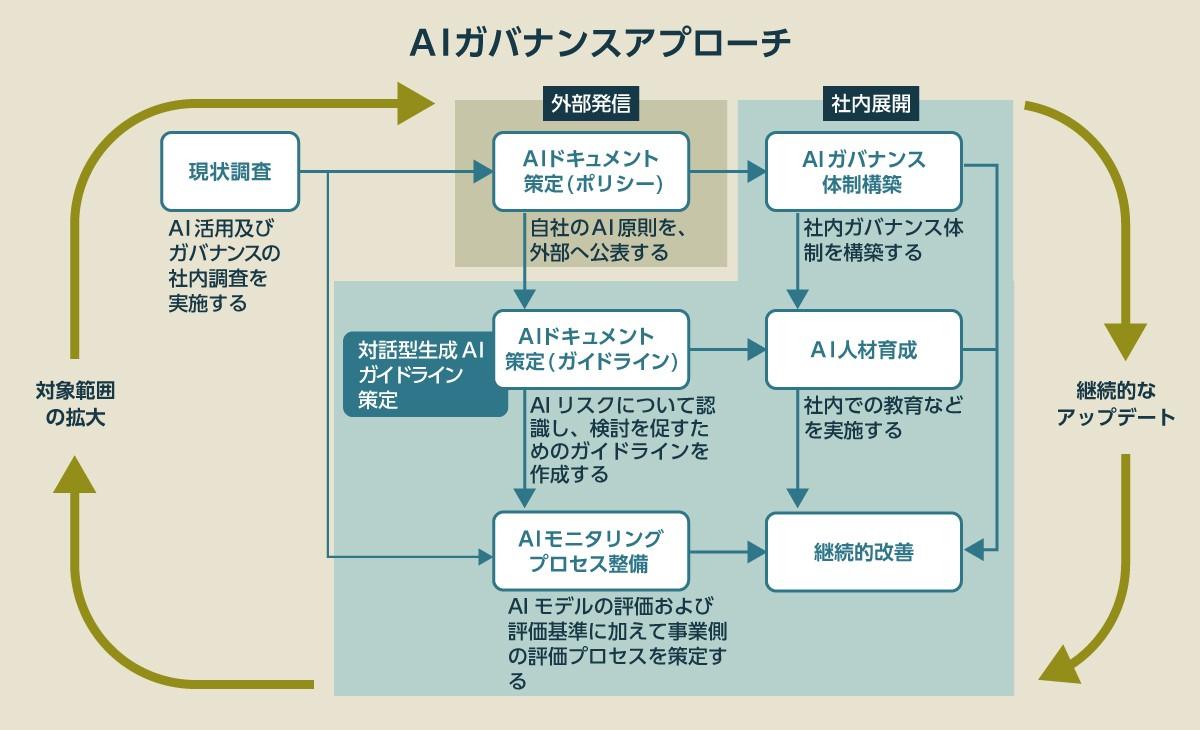

AIリスク対策の8カ条を紹介すると、「どのような順で進めるべきか」という質問をよくいただきます。

現時点では、画一的なアプローチがあるわけではありません。よって、「AI利活用やガバナンスの現在の状況による」という回答となります。

取り急ぎガイドラインを策定する事業者もいれば、人材育成を優先する事業者もいます。「1. 現状調査」を通して、自らの状況を可視化し、今後のAI戦略を加味しながら、自社に適したアプローチを検討することが大切です。さらに重要なのは、それらを一過性の取り組みで終わらせるのではなく、社内外の環境変化に応じて「8. 継続的に改善」することです(図表2)。

【図表2】AIリスク対策の進め方の全体像

(出典:PwCコンサルティングの資料を基にビジネス+IT編集部作図)

では、具体的に何をすれば良いのか──「人的/組織的対策」と「技術的対策」を詳しく確認していきましょう。 [【次ページ】「とりあえず作った」ガイドラインに潜むリスク](https://www.sbbit.jp/article/cont1/169975?page=2)

[PAGE 2](https://www.sbbit.jp/article/cont1/169975?page=2)

### 「とりあえず作った」ガイドラインに潜むリスク

冒頭で触れたように、現在、多くの事業者が「2. AIドキュメント策定」を進めています。社内ルールにとどまらず、AIポリシーやAI倫理指針として、対外的に公表している事業者も少なくありません。こうしたポリシーは、AI活用とガバナンスの両立を行う事業者としての対外的なコミットメントとなるので、あえて抽象的な粒度にとどめ、事業者ごとの個性も薄い傾向にあります。

しかしながら、「対外的なコミットメント=約束」ですので、掲げたポリシーと現場のAIリスクマネジメントの実態が合致していることは非常に重要です。公開事例などを参考に“とりあえず作った”だけでは、万が一の有事の際に「コミットメント違反」と捉えられ、事業者としての信頼が一瞬で崩壊するリスクすらあります。

また、現在のAIリスクマネジメントは、AIシステムのリリース前に実施することが主流となっています。これは、たとえばセキュリティにおけるSOC(Security Operation Center)やCSIRT(Computer Security Incident Response Team)のようなインシデント対応にあたる機能・組織が、AIにおいては発展途上であるためです。

ある意味、リリース前の工程で多くの工数を投じてリスクマネジメントせざるを得ない構造となっているのです。ただし、ここ1~2年で、AIモニタリングツールも出始めていますので、強固なガバナンス構築を目指すなら、「6. AIモニタリングツールの導入」を検討することも有用です。

今後、モニタリングツールやインシデントレスポンスのノウハウが形式知化されていくにつれて、「リリース前に注力する」という現在の方法から発展し、AIライフサイクル全体を通して、緩急あるリスクマネジメントの実装が進むでしょう。

### 8カ条「だけ」ではダメ、AI時代のあるべき「組織構造」

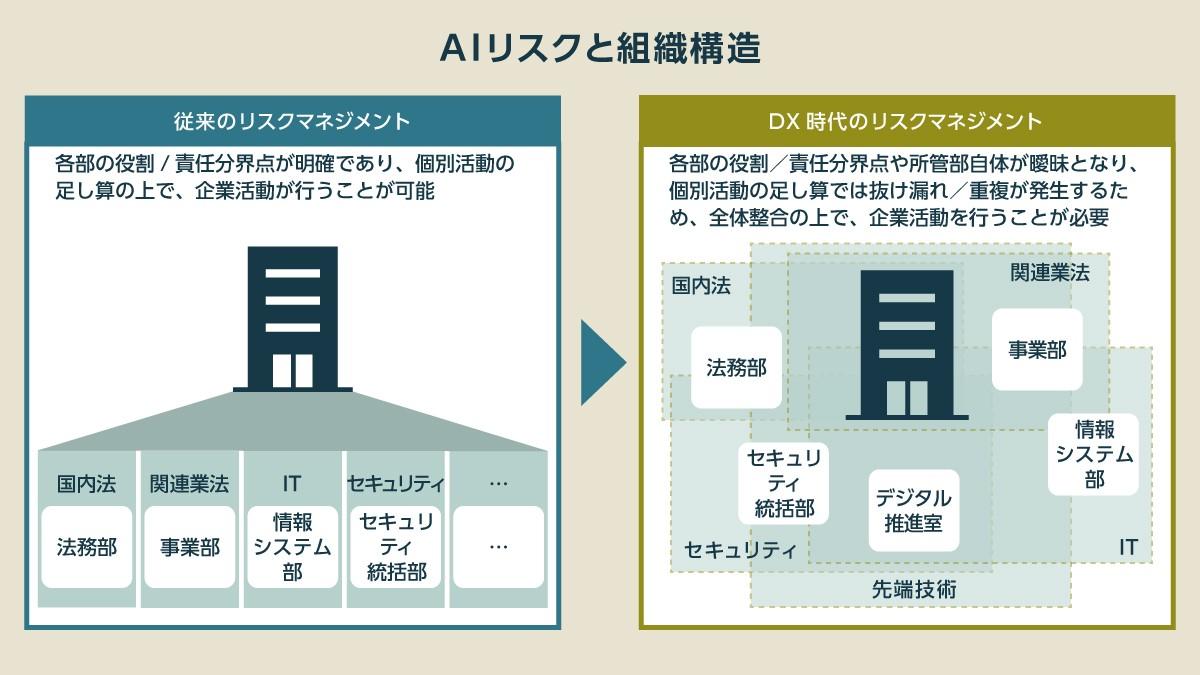

「AIリスク対策8カ条」を完璧に実施することは簡単ではありません。しかも、上記の対策だけでは、実は不十分なのです。なぜなら、AIリスクは既存のリスクと複雑に絡み合い、従来のような“部門ごとの足し算”では対応しきれないからです。

かつては、法令違反であれば法務部、システム障害であればIT部というように、リスクとそのリスクに対応する部門が1:1でひもづいていました。よって、垂直統合的な組織構造であったとしても、その“足し算”でリスクマネジメントを行うことができました。

しかし、AIならではのリスクは、AIモデルの脆弱性を起因とした情報漏えいや、学習の品質低下に伴う公平性侵害など、複数の専門性が重なり合い、法務やITなど単一部門だけでは対応できません。

このため、AIリスクマネジメントには、複数部門による協業と全体最適化の視点が必須で、組織構造も変革していく必要があります(図表3)。

【図表3】AIリスクと組織構造

(出典:PwCコンサルティングの資料を基にビジネス+IT編集部作図)

その結果、「3. AIガバナンス体制構築」においては、事業部門とコーポレート部門の責任分界点の整理のみならず、コーポレート部門間の責任分界点を定義することが不可欠となります。AIリスクに関して法務部はどこからどこまでの責任を有し、IT部はどこからどこまでの責任を有するのか……その責任分界モデルにおいて両部の協業を促進するためには、「どのような会議体や情報連携の仕組みが必要とされるのか」などが論点として挙げられます。

実は、この論点は「2. AIドキュメント策定」にも存在しています。AI関連のルールは、ITガイドラインに記載するのか、セキュリティガイドラインに記載するのか、その際の改廃の権限はどこが有するのかなど、非常に複雑で難易度が高い課題となります。

### 従来通りではもう限界、“新部門”を作る企業も続々

このような課題を解決する1つの方法として、「AIリスクマネジメント部」を新規に作るという動きがあります。「当該部門がハブとなり、他関連部門との協業を推進する」「当該部門の所管文章として、AIガイドラインを新規で策定する」などがその主な活動です。組織を新設することは容易ではありませんが、大変有効な方法だと考えられます。

一方で、3~4年前に個人情報保護などの取り扱いに関して「プライバシーガバナンス」という考えが台頭し、注目を集めていたことを思い出します。プライバシーリスクでも法務部とセキュリティ部の責任分界点が曖昧であり、AIと同じような議論が活発に行われていました。

現在の企業においては、プライバシーリスクを所管する部門があることは珍しくありません。今後も先端技術の連続的な台頭を受けて、現時点では未知のリスクが顕在化していくことが予想されます。

プライバシー部門やAI部門を設けること自体に異を唱えるわけではありませんが、台頭の度に部門を新設していては、コーポレート部門の肥大化を招いてしまいます。

パッチワーク的なリスクマネジメントは限界を迎えつつあり、今こそリスクマネジメントの全体整合に向き合うタイミングを迎えているのかもしれません。なお、先進的なガバナンスモデルとして、経済産業省から「 [GOVERNANCE INNOVATION](https://www.meti.go.jp/shingikai/mono_info_service/governance_model_kento/pdf/017_s02_00.pdf) 」が公開されていますので、合わせて紹介します。

### 経産省も提唱する「アジャイル・ガバナンス」とは何か?

AIリスクは多岐にわたり、マネジメントすべき課題も多層的です。だからと言って、「AIリスクマネジメントの態勢が整わないからAI活用は先送りせざるを得ない」と立ち止まるべきではありません。むしろ、「AIリスクマネジメントをとりあえずやってみる」という考えが重要です。

その理由は大きく2つあります。

第1に、AIリスクは既存リスクと複雑に絡み合っているということは、裏を返せば、既存部門でAIリスクマネジメントをある程度は行えるということです。既存部門ではAI特有のリスクにまで対応することは難しいかもしれませんが、コーポレート部門の専門家である彼らは、部門の上長や社外有識者を巻き込んで対応するという経験を積んでいるでしょう。AI特有のリスクに直面した際も、まずはこれと同じ動きをすれば良いのです。

そして、2つ目は、AI活用は段階的に進んでいくと想定されるため、突然、著しく高いリスクが発生する可能性は極めて低いということです。AI活用を始めたばかりの事業者が、いきなり、社外のユーザーに対して機微な情報を取り扱い、直接的に回答を返すようなAIサービスを提供するとは考えられません。

まずは、社内の従業員向けにそれほどセンシティブではない情報を取り扱い、業務効率化に利用する。これが成功した後に、社内向けの高付加価値業務に利用する。次に社外向けの1次成果物作成に利用する(1次成果物を従業員が確認したうえで利用する)など、AI利活用は徐々に発展していくものです。

つまり、初期段階においては、リスクは限定的なので、AIリスクマネジメント態勢の一部に課題があったとしても十分に目的を果たすことができるはずです。この段階における成功と失敗を整理し、失敗の要因を分析して改善につなげていけば良いのです。こうした試行錯誤によりAIリスクマネジメントは高度化し、その結果、AI利活用の次段階や次々段階のAIリスクマネジメントでも適切に対応することが可能になります。

経済産業省が提唱する「GOVERNANCE INNOVATION」では、「アジャイル・ガバナンス」に言及しています。ガバナンス態勢自体をアジャイルで構築していくという考え方です。

AIリスクマネジメントは、まさにアジャイル・ガバナンスが適しています。AIリスクマネジメント態勢が整うのを待つのではなく、AI活用の段階と合わせて、今できることをいまやり始める、そして課題に対しては改善していく、という姿勢が重要です。

リスクマネジメント態勢の懸念から、事業者としてのブレーキを踏みすぎることのないよう、攻めと守りの両立こそが、本来のリスクマネジメントの役割であることを忘れてはいけません。

**〔参考文献〕**

- 経済産業省「 [GOVERNANCE INNOVATION: Society5.0の実現に向けた法とアーキテクチャのリ・デザイン](https://www.meti.go.jp/shingikai/mono_info_service/governance_model_kento/pdf/20200713_1.pdf) 」

- 経済産業省「 [GOVERNANCE INNOVATION Ver.2: アジャイル・ガバナンスのデザインと実装に向けて](https://www.meti.go.jp/shingikai/mono_info_service/governance_model_kento/pdf/20210730_1.pdf) 」

- 経済産業省「 [GOVERNANCE INNOVATION Ver.3: アジャイル・ガバナンスの概要と現状](https://www.meti.go.jp/shingikai/mono_info_service/governance_model_kento/pdf/20220808_1.pdf) 」

関連タグ タグをフォローすると最新情報が表示されます

- [AI・生成AI](https://www.sbbit.jp/genretaglist/175)

- [ガバナンス・内部統制・不正対策](https://www.sbbit.jp/genretaglist/38)

## AI・生成AIの関連コンテンツ

あなたの投稿

PR

PR

PR