---

> [!NOTE] 目次

```table-of-contents

title:

minLevel: 0

maxLevel: 0

includeLinks: true

```

---

> [!NOTE] リスト掲載用文字列

- [LM Studioの使い方|Masayuki Abe](https://note.com/masayuki_abe/n/nd65ed694eec0)【note(ノート)】(2024年02月03日)

---

> [!NOTE] この記事の要約(箇条書き)

- LM Studioは、ローカル環境で言語モデル(LLM)の検索、ダウンロード、会話、およびサーバ機能を提供するGUIベースのツールです。

- プログラミング経験がない方やLLMを試したい方にとって、手軽に設定できる有益なツールとして紹介されています。

- Windows PCへのインストールは、公式サイトからダウンロードし実行するだけです。

- 言語モデルのダウンロードは、LM Studio内でモデル名を検索し、「Download」ボタンをクリックすることで行えます(例としてOpenHermes 2.5が使用)。

- ダウンロードしたモデルは、LM Studio内のチャット機能で利用でき、ユーザーは質問を投げかけることができます。

- 著者の検証では、日本語での応答には課題があるものの、英語ではより適切な回答が得られました(16GBメモリ環境では動作が遅いと感じられたとのこと)。

- LM Studioは言語モデルサーバとしても機能し、指定されたポート(デフォルト1234)で動作し、curlやPythonなどのクライアントからアクセスするためのサンプルコードが提供されます。

- CUIでのローカルLLM操作にはOllamaが、ARM版LM StudioはCopilot+PC向けに別途記事が紹介されています。

> [!NOTE] 要約おわり

---

## LM Studioの使い方

[Masayuki Abe](https://note.com/masayuki_abe)

LM Studioとは、ローカル環境で、言語モデルを探してダウンロードしたり、言語モデルを利用して会話が出来たり、言語モデルサーバとしての機能も果たします。

所感は、GUIベースで操作できるので、プログラミングに馴染みの無い人や、言語モデルを試してみたい人には手軽に設定することができるので有益なツールだと思います。

今回は、LM StudioをWindows PCにインストールして使う方法を纏めてみました。

## LM Studioのインストール

下記のページからダウンロードしてきます。

[**LM Studio - Local AI on your computer** *Run local AI models like gpt-oss, Llama, Gemma, Qwen, and Dee* *lmstudio.ai*](https://lmstudio.ai/)

上記ページの"Download LM Studio for Windows"をクリックしてダウンロードし、Windows PCにインストールします。

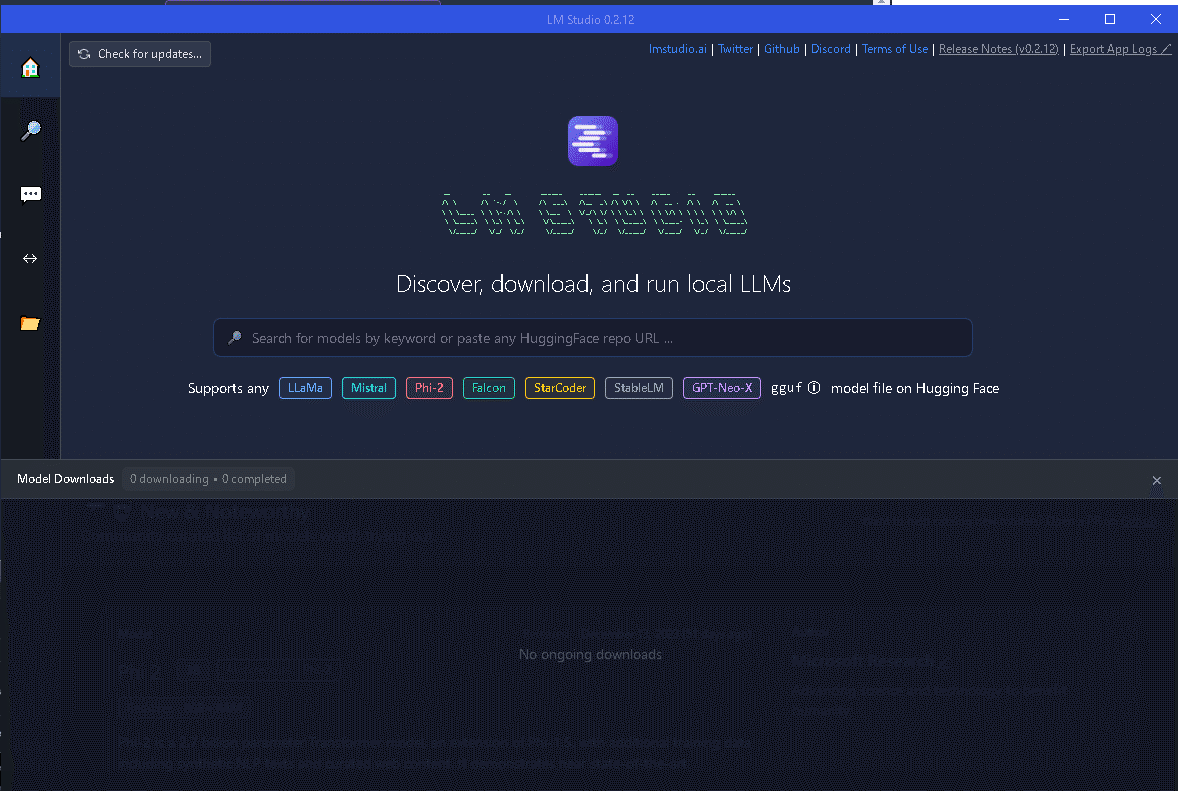

LM Studioの初期画面

## 言語モデルのダウンロード

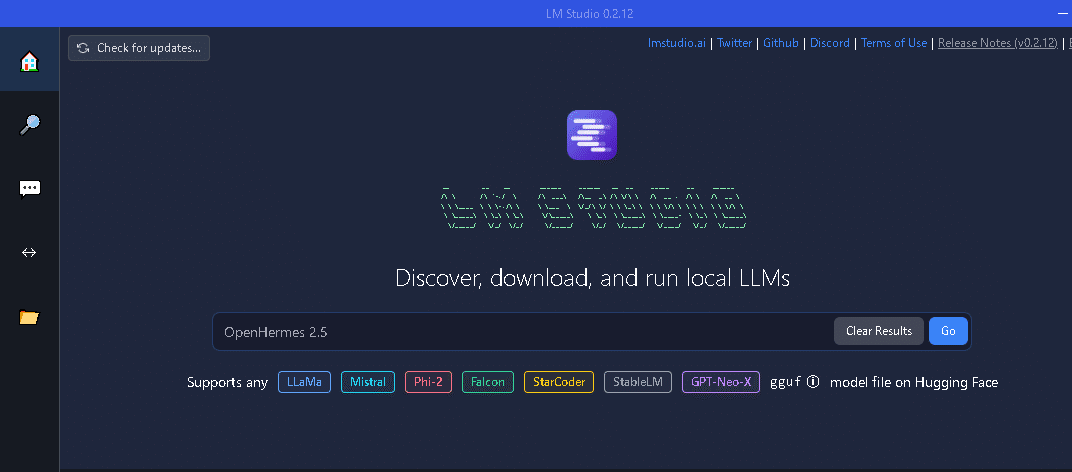

次に、OpenHermes 2.5と入力し、Goをクリックします。

検索画面

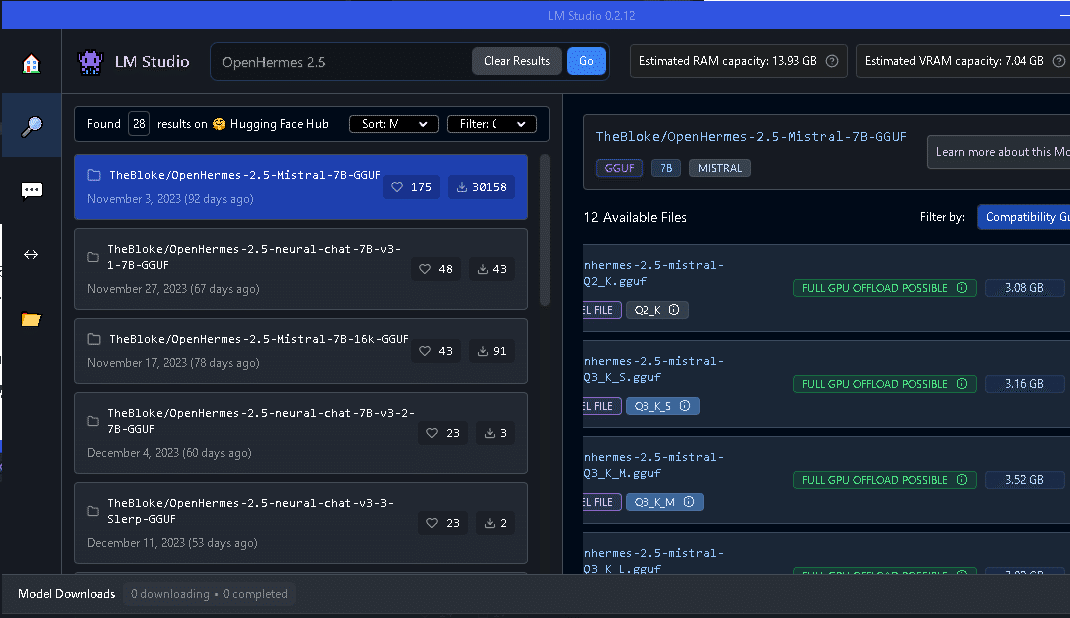

検索結果が出力されます。

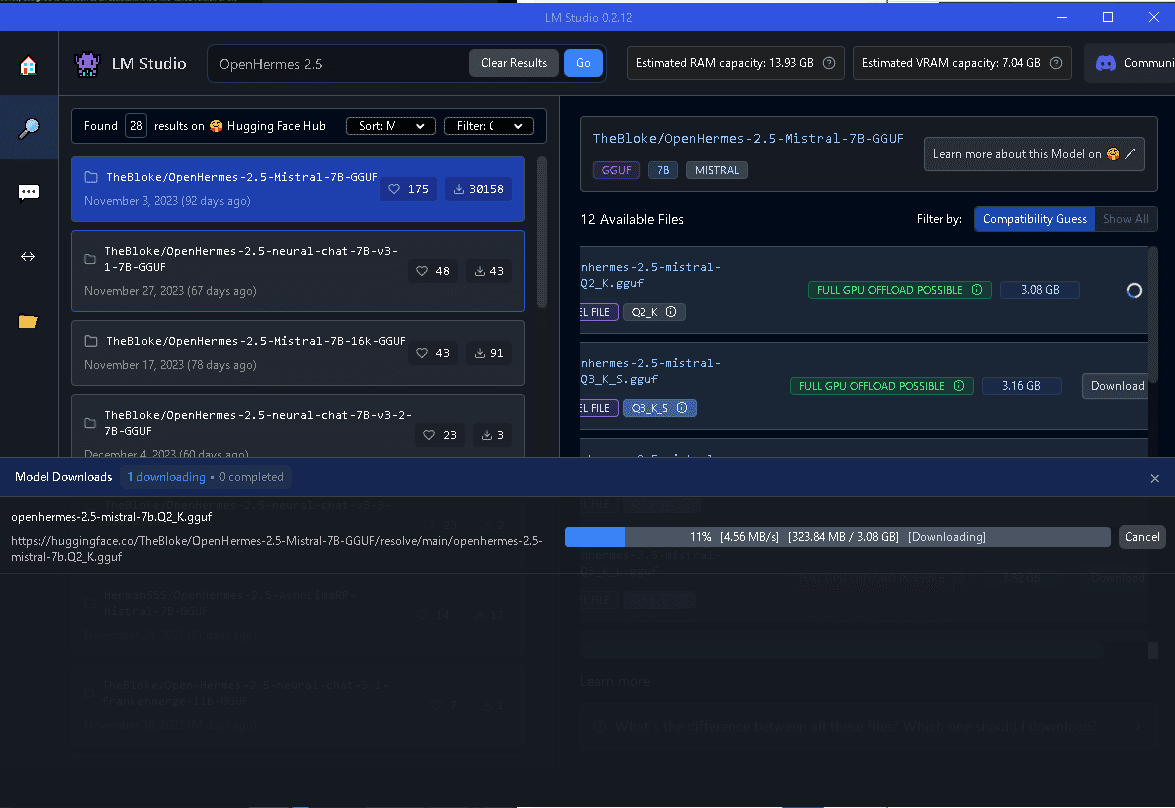

次に、右側の"Download"をクリックします。

下の方の画面に、ダウンロード状況が出力されます。

ダウンロード状況

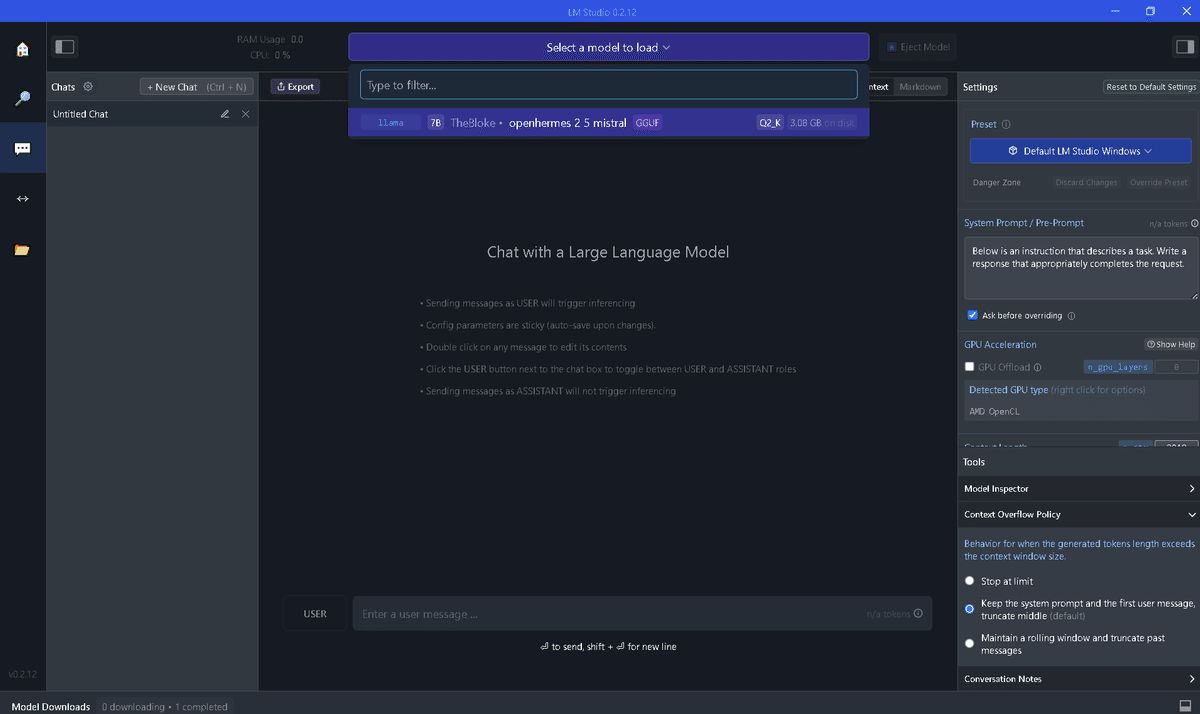

ダウンロードが完了したら、左側の上から3番目の吹き出しマーク(AIChat)をクリックします。次に、上部の"Select a model to load"をクリックし、先ほどダウンロードしたopenhermesを選択します。

言語モデル選択画面

これで、準備が完了しました。

## 言語モデルの実行

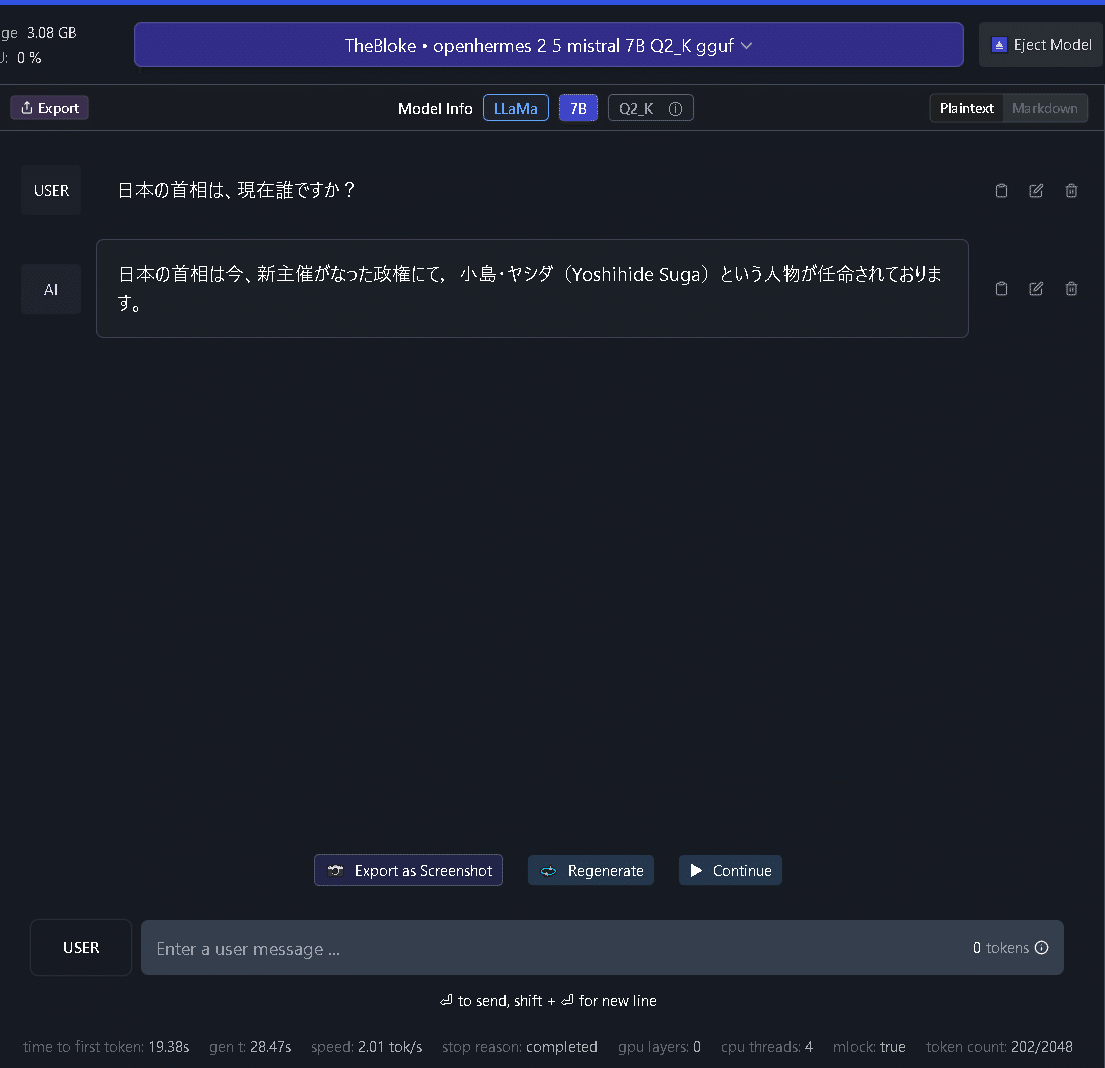

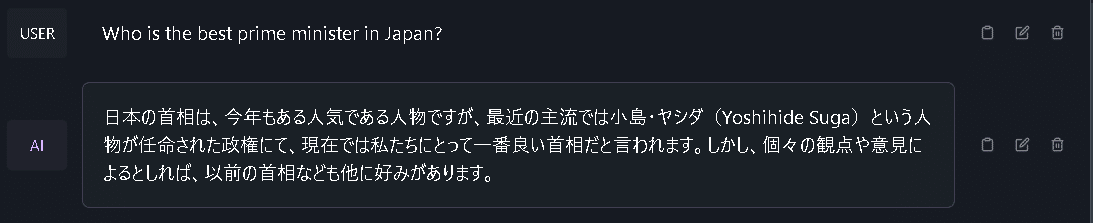

下部のところにあるUSERの入力フォームに色々と入力して聞いてみましょう。

日本の現在の首相を聞いてみました。

日本語は理解できるようですけれど、この言語モデルだと厳しい感じがします。

今回の実行環境は、Memory16GBのパソコンです。実行時は遅く感じましたが自身のパソコンで出来るのは驚きです。

今度は、英語で、もっともベストな首相は誰かと聞いてみましょう。

英語で聞いてみました。

このように、言語モデルを読み込んで、その言語モデルを利用して、GUI形式で会話ができます。

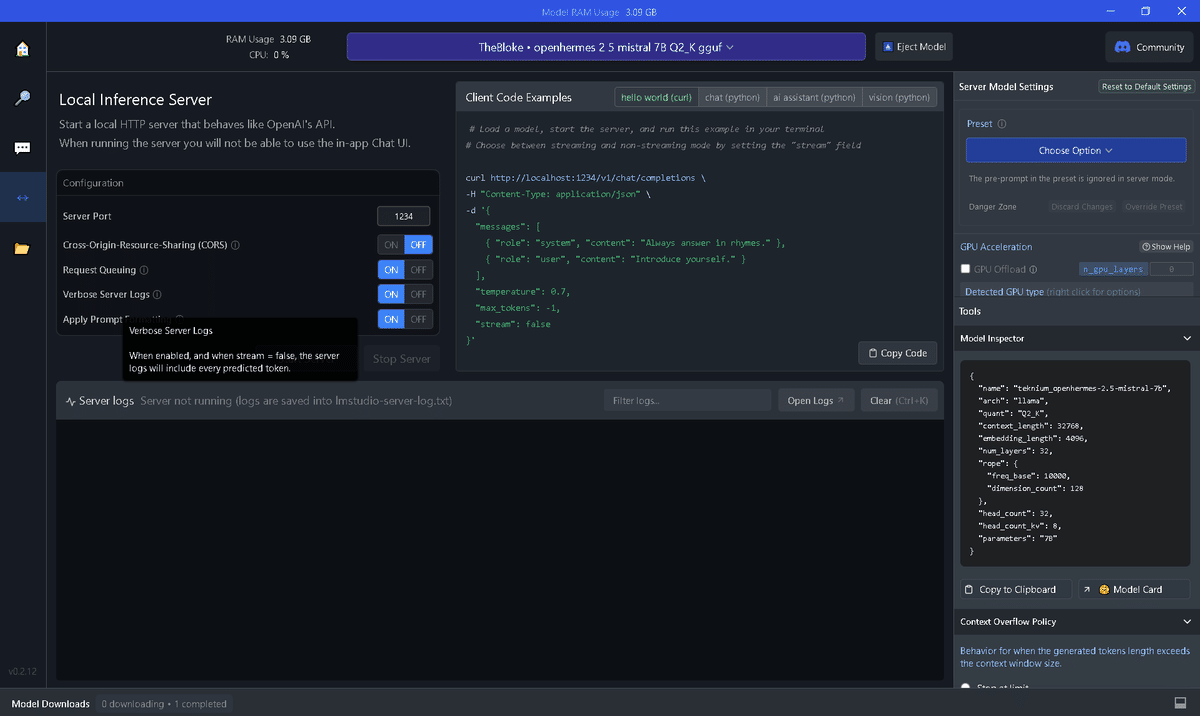

## 言語モデルサーバとしての使い方

他にも、言語モデルを読み込んだ環境を言語モデルのサーバとして利用できます。

左側の上から4番目の⇔をクリックします。

サーバ設定

左側のところに、Server Port 1234で、1234ポート経由でアクセスができるということです。

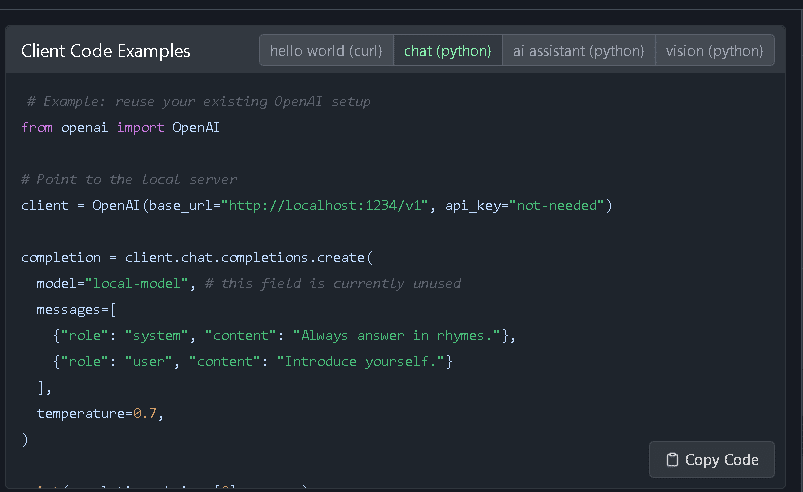

また、真ん中のClinet Code Examplesには、このサーバにアクセスするときのcurl, pythonなどのサンプルコードがあります。

サンプルコード

上記のコードをPython環境で実行してみますと、下記のように出力されました。

> ChatCompletionMessage(content="Hey there, it's me, I'm the Yoda guy,\\nWith knowledge vast and wide, under the sky.\\nMy rhymes are my power, in wisdom and might,\\nGuiding you through life, making everything right!", role='assistant', function\_call=None, tool\_calls=None)

実行結果

2024/05/03追記

GUIではなくCUIが好きな人は、ollamaというツールでローカルLLMを操作できます。

(追記2024/06/29)

ARM用のLM Studioの記事を書きましたので、Copilot+PCでSnapdoragon利用している人は参考になります。

## いいなと思ったら応援しよう!

LM Studioの使い方|Masayuki Abe